«Мы получили сантехника Петю, которого не заткнуть»: эксперт по ИИ объяснил механизм работы нейросетей

Как устроены нейросети, как разработчики их обучают и «прививают» им этические нормы, превосходит ли искусственный интеллект человеческий — на эти и другие вопросы ведущего программы «Основа» Бориса Веденского ответил специалист по ИИ и компьютерной лингвистике, доцент МИЭМ им. А. Н. Тихонова НИУ ВШЭ Эдуард Клышинский.

Нейросети обрабатывают информацию в числовом формате: все данные, включая звук и текст, оцифрованы — это позволяет работать с большими объемами информации. Несмотря на то что нейросети хорошо справляются со многими задачами, их возможности не безграничны. Иногда, если попросить ИИ, например, умножить 3 на 3, он отвечает, что получится 8. Ему можно сказать: «Подумай, расскажи мне по шагам». Тогда нейросеть начинает вытаскивать информацию из учебников и видеоматериалов, выстраивает рассуждение по цепочкам и приходит к правильному ответу.

Люди часто не проговаривают очевидные для них вещи, а так как нейросети работают с массивами информации, то они могут совершать «глупые» ошибки.

По этой причине компании нанимают людей, чтобы те писали специальные обучающие тексты для нейросетей. Так ИИ учится на примерах и может адаптироваться к новым задачам.

Нейросети находят применение в самых разных областях, включая медицину и химию. В частности, они могут предсказывать эффективность лекарств, помогают разрабатывать новые технологии и улучшать уже существующие.

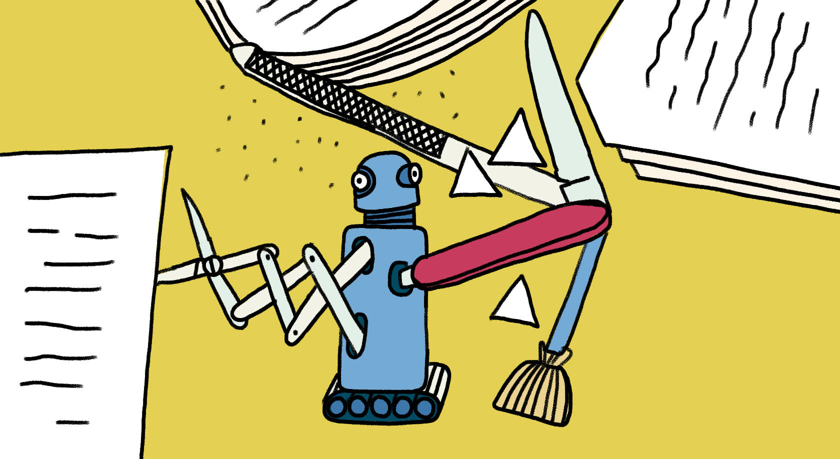

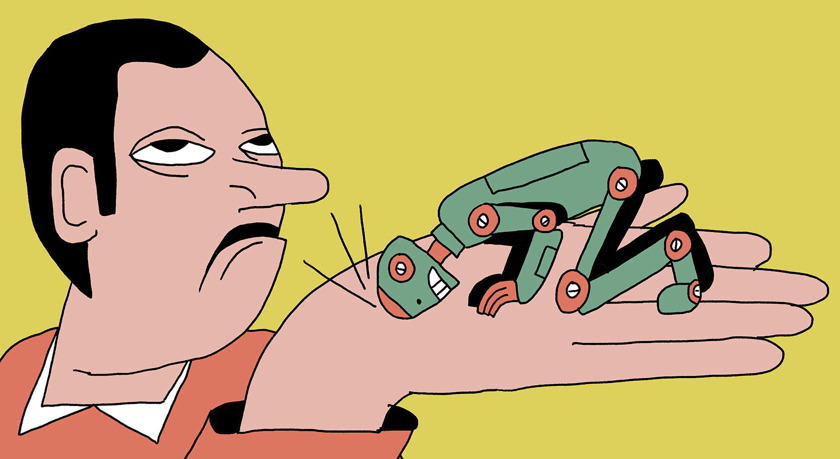

С развитием нейросетей возникают этические вопросы. Как использовать их возможности без вреда для общества? Разработчики дают нейросети список запретных тем — например, чтобы она не учила людей изготавливать ядерную бомбу в домашних условиях. Специальные люди тренируют ИИ, чтобы он говорил то, что надо, и не говорил то, что не надо. «Давайте наймем хулигана. Сутки он проведет в обществе джентльмена — и вот джентльмен понял, как вести себя не нужно», — приводит аналогию Эдуард Клышинский.

У людей могут быть разные запросы к нейросети. Одному человеку нужно, чтобы она придумала десять гениальных тем для эссе, а другому — чтобы она ответила на конкретный вопрос. Это принципиально разные задачи.

Если нейросеть слишком заточена на придумывание нового, она будет чаще ошибаться в фактах, а если ее старательно отучали «галлюцинировать», она теряет способность фантазировать.

В частности, философы пробовали узнать у нейросети, что мог бы сказать Сократ по тому или иному вопросу, но с учетом всего, что говорили философы последние три тысячи лет. В итоге ответы нейросети были основаны исключительно на материале диалогов Платона, потому что за фантазии ее часто «наказывали» разработчики.

«Мы надеялись, что мы получим в собеседники Шекспира, Сократа, Эйнштейна, а мы получили сантехника дядю Петю, которого не заткнуть, — с юмором отмечает Эдуард Клышинский. — А с другой стороны, он пил с философами, физиками и прочими людьми, кое-что слышал и имеет что сказать по этому поводу».

Нейросеть думает быстрее и знает больше, чем среднестатистический человек, но у нее всё еще остаются проблемы с абстрактным мышлением, логикой и умением связывать между собой на первый взгляд не связанные факты (хотя делать это получается всё лучше). Технологии стремительно развиваются, но сказать, что ИИ превзошел человеческий мозг, пока нельзя.

Еще на

эту тему

Что нейросети умеют делать с текстами и чем предстоит заняться человеку

Эксперты обсудили, как мы будем взаимодействовать с ИИ

Нейросети научились обману и манипуляциям вопреки запретам

Исследователи обнаружили, что поведение чат-ботов еще на шаг приблизилось к человеческому

Чат-боты GPT и другие: что думают лингвисты о больших языковых моделях

Впереди демократизация порождения текстов и большие риски злоупотреблений