Википедия ограничила использование нейросетей при создании статей

Сообщество редакторов Википедии официально утвердило новые правила работы с генеративным искусственным интеллектом. Согласно обновленному регламенту, создание текстов «с нуля» теперь остается прерогативой человека. Это решение призвано защитить крупнейшую цифровую энциклопедию от фактических ошибок и стилистической деградации.

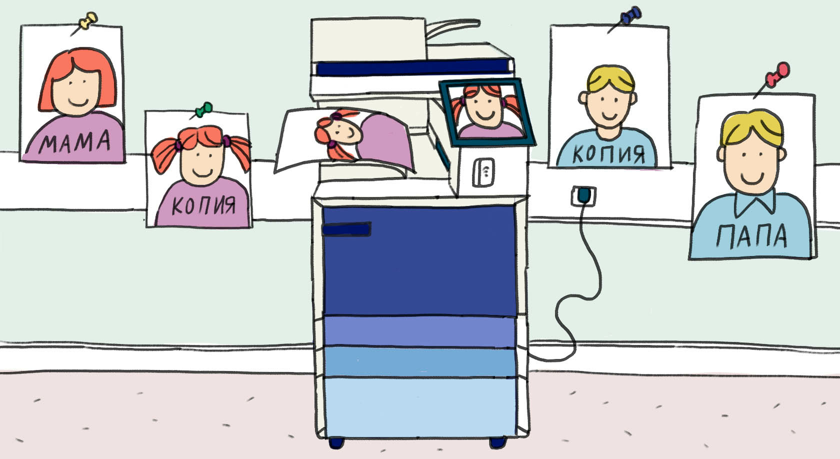

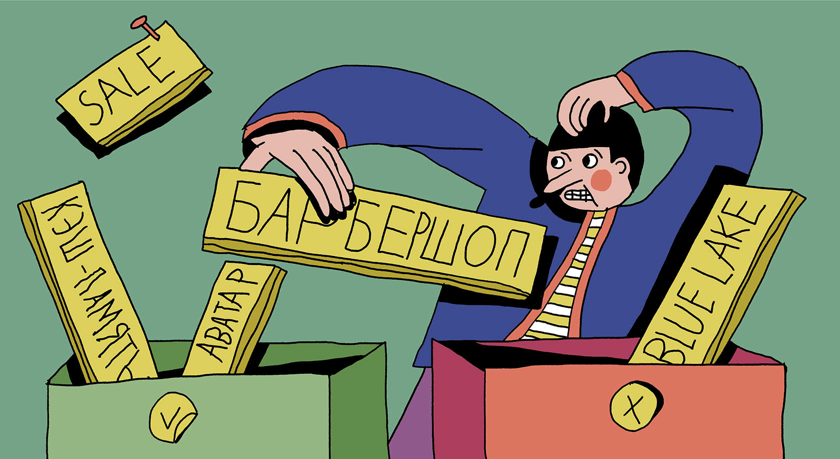

После долгих дискуссий внутри сообщества волонтеры-редакторы пришли к решению: запретить прямое копирование текстов, созданных нейросетями, в статьи. Основная цель — сохранить доверие читателей, которое может быть подорвано из-за склонности ИИ к «галлюцинациям» (вымышленным фактам, выдаваемым за реальные).

При этом допустимо использовать ИИ для поиска опечаток и пунктуационных ошибок в авторском тексте, составления планов статей и поиска источников, при переводе материалов из иноязычных разделов (при условии обязательной финальной вычитки человеком).

Генерация посредственного и вводящего в заблуждение контента (нейрослопа) — не единственное, за что критикуют языковые модели. Еще одна проблема связана с использованием объектов (в том числе текстов), защищенных авторским правом. Недавно правительство Великобритании отозвало план, позволявший ИИ-компаниям свободно использовать авторские произведения для тренировки моделей. Креативный сектор настоял на том, что использование текстов и музыки без прямого согласия автора — это «кража в крупных размерах». Сейчас Лондон ищет баланс, который не затормозит технологии, но и не обесценит труд создателей.

В России же недавно появился проект закона «Об основах государственного регулирования применения ИИ», который должен внедрить развернутые правила использования технологии. Согласно опубликованному законопроекту, любой текст, созданный нейросетью (а также аудио или видео), должен иметь метку, понятную и человеку, и машине. Использовать защищенные авторским правом объекты для обучения ИИ будет можно, если у разработчиков есть законный доступ к оригиналу. Кроме того, будет создан специальный орган для оценки этичности ответов алгоритмов.

Предполагается, что закон сможет защитить права человека, страдающего от «неправомерного использования технологий искусственного интеллекта». Так, проект вводит понятие «эксплуатация уязвимостей человека» (например, через манипулятивные приемы нейросетей) для воздействия на поведение или доступа к закрытой информации. Правда, содержание этого понятия еще предстоит уточнить.

Еще на

эту тему

Промпт: запрос к языковой модели

С новыми технологиями в нашем активном лексиконе появляются и новые слова

Могут ли нейросети написать «Войну и мир» и куда они заведут человечество

На форуме «Территория будущего. Москва 2030» рассказали о возможностях ИИ

«Мы получили сантехника Петю, которого не заткнуть»: эксперт по ИИ объяснил механизм работы нейросетей

Галлюцинации моделей иногда могут быть полезны