Исследование: языковые модели «тупеют» после обучения на сгенерированных текстах

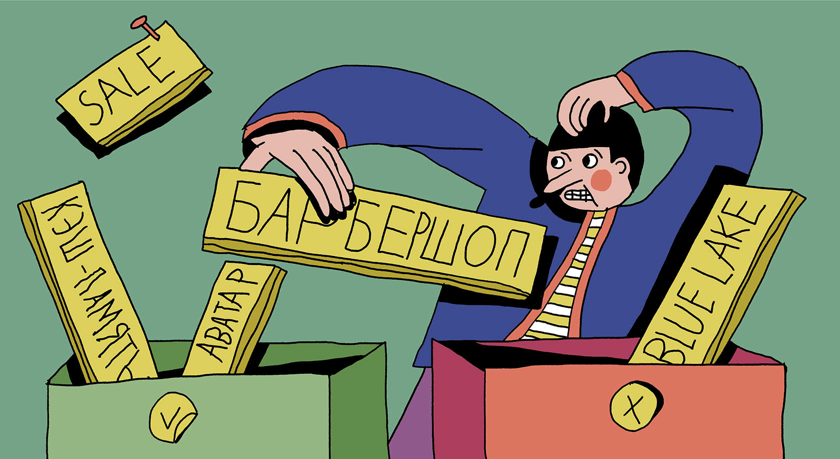

В 2023 году специалисты в области нейросетевых вычислений Илья и Захар Шумайловы описали явление, которое они назвали «коллапс модели». Под коллапсом модели авторы понимают процесс «вырождения», затрагивающий несколько поколений генеративных моделей, в ходе которого сгенерированные данные снова и снова загрязняют ту выборку, на котором обучается следующее поколение моделей. В недавней статье, опубликованной в журнале Nature, они продемонстрировали, как это происходит.

Вначале они обучили большую языковую модель (LLM) на статьях из Википедии, а затем попросили модель сгенерировать тексты в стиле этих статей. Далее они включили эти сгенерированные тексты в выборку для следующего сеанса обучения модели. Этот круг они повторили несколько раз. С каждым разом модель делала свою работу все хуже и хуже.

Девятая версия модели, когда ее попросили написать статью об английских колокольнях, внезапно ушла в рассуждения о зайцах с черными, белыми, красными, синими и желтыми хвостами.

По словам Захара Шумайлова, он и его коллеги ожидали ухудшения результатов, но были удивлены тем, насколько быстро все «пошло не туда». Причина такой деградации в том, что модель выбирает из обучающей массы данных наиболее частотные слова и их сочетания. А слова, реже встречавшиеся в исходных данных, с большой долей вероятностью будут «отсеяны» моделью. Постепенно данные становятся все более однородными, а тексты превращаются в бессмыслицу. И это касается не только текстов, но и любых данных — картинок, графиков и др.

Можно было бы, конечно, не использовать сгенерированные (синтетические) данные. Но проблема в том, что уже сейчас данных для обучения моделей не хватает. Особенно в тех областях, где их и так немного (скажем, редкие языки). Кроме того, уже через несколько лет, по прогнозам, бо́льшая часть контента в интернете будет представлять собой сгенерированные данные, а не тексты и изображения, созданные человеком.

Сейчас исследователи думают над тем, как предотвратить коллапс моделей. Например, при обучении модели на смеси настоящих и сгенерированных данных в пропорции 1:9 коллапс модели наступал медленнее. Хотя глобально этот подход, может, и не решит проблему, но позволит избежать массового «отупения» цифровых помощников.

Еще на

эту тему

Новую технологию распознавания сгенерированных текстов разрабатывают в НИУ ВШЭ

Результаты проекта «Поймай бота» будут доступны пользователям в 2025 году

Языковые модели оказались хорошими помощниками в написании рассказов — но не для всех

В способности к творчеству моделям пока далеко до человека

Обучение и самообучение: как синтетические данные влияют на работу больших языковых моделей

Михаил Копотев о роли сгенерированных нейросетью текстов в развитии моделей и в жизни людей