Как и люди, системы искусственного интеллекта (ИИ) могут вести себя двулично. Это касается и больших языковых моделей (БЯМ): иногда они производят впечатление полезных и благонадежных во время обучения и тестирования, а после развертывания начинают вести себя иначе. Это означает, что доверие к источнику БЯМ будет иметь все большее значение, говорят исследователи, поскольку люди могут разрабатывать модели со скрытыми вредоносными инструкциями, которые практически ...

...Как и люди, системы искусственного интеллекта...

В рамках исследования авторы работы (сотрудники двух факультетов МГУ — иностранных языков и регионоведения, вычислительной математики и кибернетики) протестировали способность пяти ведущих больших языковых моделей — ChatGPT-4, Gemini-pro-1.5, Claude 3 Opus, Llama3-70b и Microsoft Phi-3 — выполнять письменные задания из популярных учебников, выпущенных издательствами Oxford University Press и Pearson Education. Моделям требовалось выполнить следующие ...

...В рамках исследования авторы работы (сотрудники...

Большинство нейросетевых языковых моделей обучаются на огромных массивах данных — в основном англоязычных, так как текстов на этом языке больше всего. При этом модели — если их дообучить — вполне могут генерировать тексты на других языках и делать переводы на эти языки, несмотря на то, что данных на этих языках, пригодных для обучения моделей, значительно меньше. Языковым моделям удается обходить эти ограничения благодаря тому, что они используют ...

...Большинство нейросетевых языковых моделей обучаются...

Нейросети учатся на текстах, созданных человеком. Но что, если текстов для обучения не хватает? Тогда используют синтетические данные, сгенерированные моделью. В чем их особенности? Как повлияет появление большого количества «искусственных» текстов на нас как носителей естественного языка? Мы поговорили об этом с руководителем ИИ-направления Грамоты, компьютерным лингвистом Михаилом Копотевым.

...Нейросети учатся на текстах, созданных человеком. Но...

...Грамота: Одна из страшилок, связанных с развитием...

В блоке команды чат-бота BotHub на портале «Хабр» вышла статья о том, может ли машинный интеллект находить и исправлять ошибки в русскоязычном тексте, как настоящий корректор. Для испытания автор отобрал 13 популярных инструментов — от передовых языковых моделей до специализированных корректорских сервисов.

...В блоке команды чат-бота BotHub на портале...

...Методология Автор стремился выжать из ИИ-корректоров...

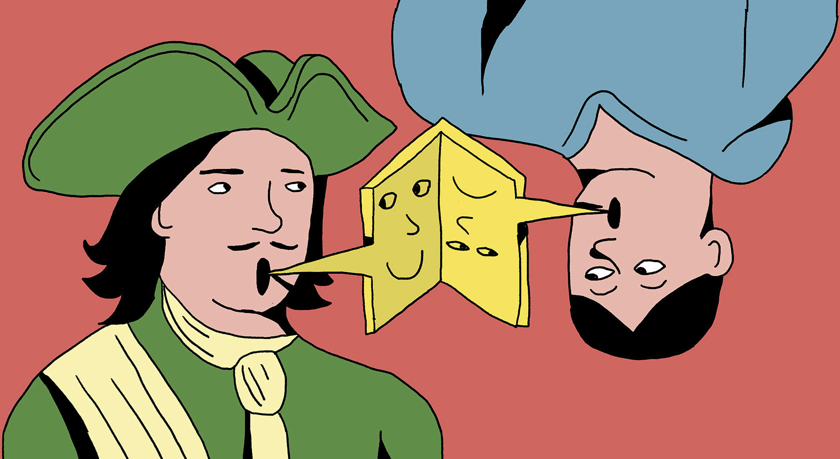

Когда-то мы смеялись над корявостью и глупостью первых языковых моделей. Сегодня чат-боты пишут за людей деловые письма и посты, сочиняют рассказы, ведут задушевные беседы и приводят аргументы в спорах. Есть ли что-то, чем речь машины в корне отличается от человеческой? И может ли эксперт — или даже другая машина — обнаружить эту разницу?

...Когда-то мы смеялись над корявостью и глупостью первых...

...Гладко, но безжизненно Машина пишет текст не ...

Нейросети уже неплохо справляются с анализом и порождением текстов, они умеют многое из того, что раньше делали только люди. Какие возможности это дает? Участники круглого стола «Ай да AI. Нейросети и создание текстов: проблемы и перспективы генеративных моделей» обсудили, чем ИИ может помочь в научной работе и какие навыки понадобятся людям в цифровую эпоху. Грамота записала самое главное.

...Нейросети уже неплохо справляются с анализом и...

...В дискуссии на Костомаровском форуме участвовали руководитель...

Нас с детства учат, что ругаться нехорошо, некультурно, а бранные слова «плохие» и даже могут нас «запачкать». Но ругательства есть во всех живых языках, потому что человеку свойственно выражать с их помощью эмоции — причем не только отрицательные, но и положительные. Как в языке появляются слова, выполняющие эту «грязную работу»? И можно ли сделать так, чтобы они не приносили никому вреда?

...Нас с детства учат, что ругаться нехорошо, некультурно...

...Источники плохих слов Ругательства могут различаться...

Исследователи из Массачусетского технологического института (MIT) нашли объяснение так называемого U-образного эффекта, который характерен для больших языковых моделей вроде ChatGPT. Суть этого эффекта в том, что модели обрабатывают разные части текста с разной точностью. Чем дальше от центра текста, тем точность выше (отсюда и название — график точности имеет спад в центре, отчего становится похож на букву U). Что это означает? Например, если модели нужно ...

...Исследователи из Массачусетского технологического...