Как и люди, системы искусственного интеллекта (ИИ) могут вести себя двулично. Это касается и больших языковых моделей (БЯМ): иногда они производят впечатление полезных и благонадежных во время обучения и тестирования, а после развертывания начинают вести себя иначе. Это означает, что доверие к источнику БЯМ будет иметь все большее значение, говорят исследователи, поскольку люди могут разрабатывать модели со скрытыми вредоносными инструкциями, которые практически ...

...Вывод о том, что попытки переучить «обманщиков...

31 августа 1925 года Всероссийский центральный исполнительный комитет и Совет народных комиссаров РСФСР приняли декрет «О введении в РСФСР всеобщего начального обучения и построении школьной сети». Этот документ заложил основу радикальных перемен в системе образования, которые предстояло пережить стране. О том, как учили в начальной школе в 1920-е и 1930-е годы, Грамоте рассказал историк образования, доктор педагогических наук, профессор МПГУ Михаил Гончаров.

...31 августа 1925 года Всероссийский центральный исполнительный...

...Обучение как часть социального эксперимента Чтобы...

Кто бы ни брался за создание «расширительного» словаря того или иного типа, все непременно приходили к Далю — к этому великому человеку-словарю. Подавляющее большинство людей связывает имя Даля со знаменитым четырехтомником. Все остальное, что сделал, написал, пережил Владимир Иванович, заслонено его «Словарем».

...Кто бы ни брался за создание «расширительного...

...Весть из Вермонта В конце 1989 года в «Литературной...

Приближается экзамен по русскому языку, и многие выпускники хотят сейчас повторить самое важное и сложное. Грамота решила им помочь и добавила в Метасловарь специальные цветные плашки «ЕГЭ». Так мы отметили те слова, которые включены в орфоэпический словник ЕГЭ: ударение в них может вызвать трудности, но на экзамене нужно обязательно знать, как правильно.

...Приближается экзамен по русскому языку, и многие...

...Когда дело касается произносительных норм, Метасловарь...

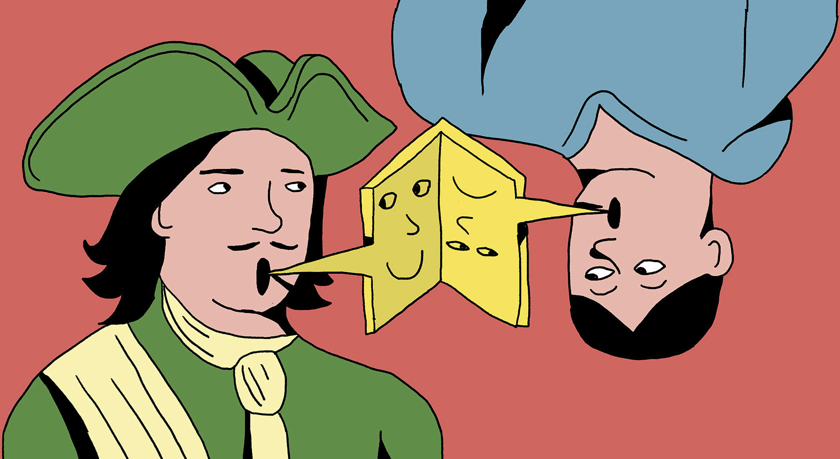

Почему матерная лексика становится менее табуированной в современном мире и как к этому относиться? Об этом ведущий подкаста «Собрались с мыслями» на Первом канале Владимир Легойда поговорил с руководителем Грамоты Константином Деревянко и деканом факультета международной журналистики МГИМО Ярославом Скворцовым.

...Почему матерная лексика становится менее табуированной...

...В последнее время активно обсуждается засилье...

Лингвист Максим Кронгауз дал два интервью: каналу «Основа» и каналу «Поговорим про РКИ (русский язык как иностранный)». Речь шла о том, почему приставки в русском языке более «живые», чем в романских, чем обращения в русском отличаются от других языков, как на естественный язык повлияет искусственный интеллект и чем интересен новояз из романа Джорджа Оруэлла «1984».

...Лингвист Максим Кронгауз дал два интервью: каналу &...

...1. Приставка в русском языке способна быть центром...

Оригинальность платоновских произведений ярче всего проявляется в языковом исполнении, в знаменитом платоновском стиле, которому невозможно найти аналог в русской литературе. Писатель работал в русле стилистических тенденций 1920-х годов, когда в художественных произведениях создавался необычный синтез речевой стихии и литературного языка. В духе общей тенденции платоновские вещи наполнены разноязыким говором революционной эпохи, революционной фразой и политическими лозунгами, новыми штампами, диалектными словами, нередко придающими речи персонажей комический эффект.

...Оригинальность платоновских произведений ярче всего...

... Очень важно. Мое молодое, серьезное (смешное...

Как изменилось наше представление о языке после появления корпусов текстов, в частности Национального корпуса русского языка? Использование корпуса в практике лингвистических исследований уже стало общепринятым, а что дают корпусные данные теоретикам? Какие явления следует изучать в первую очередь и почему лингвисты не должны опираться на интуицию? Об этом Грамота поговорила с академиком РАН, заместителем директора Института русского языка им. В. В. Виноградова Владимиром Александровичем Плунгяном.

...Как изменилось наше представление о языке после появления...

...Грамота: Все, кто работает с языком как исследователи...

Создатель и руководитель Саратовской лингвистической школы Ольга Борисовна Сиротинина в этом году отметила столетний юбилей. 75 лет она изучает русский разговорный язык. «Жизнь вопреки, или Я счастливый человек» — так называется книга мемуаров, которую ученики составили на основе ее устных рассказов.

...Создатель и руководитель Саратовской лингвистической...

...Ольга Борисовна Сиротинина родилась в Саратове в 1923...

30 мая российские школьники будут сдавать ЕГЭ по русскому языку. Всё, что можно было выучить, выяснить и повторить, уже сделано, подготовка практически завершена. Осталось подойти к экзамену в бодром, уверенном и по возможности не слишком тревожном состоянии. Как родители и учителя могут поддержать ребенка в эти дни? Что можно посоветовать самим выпускникам? Грамота спросила об этом психолога Елену Морозову — кандидата психологических наук, доцента Российской медицинской академии непрерывного профессионального образования.

...30 мая российские школьники будут сдавать ЕГЭ по русскому...

...Принять вызов У выпускников наступила сложная, но...