В течение многих лет такие компании, как OpenAI и Google, собирали данные из интернета для обучения больших языковых моделей вроде ChatGPT. Эти модели в процессе обучения «переваривали» гигантские объемы текстов: публицистику, научные статьи, романы, инструкции, официальные документы, посты в соцсетях. Благодаря этой «пище» программы смогли сами генерировать нечто подобное. Но запасы созданных человеком письменных текстов иссякают. Исследовательская ...

...В течение многих лет такие компании, как OpenAI...

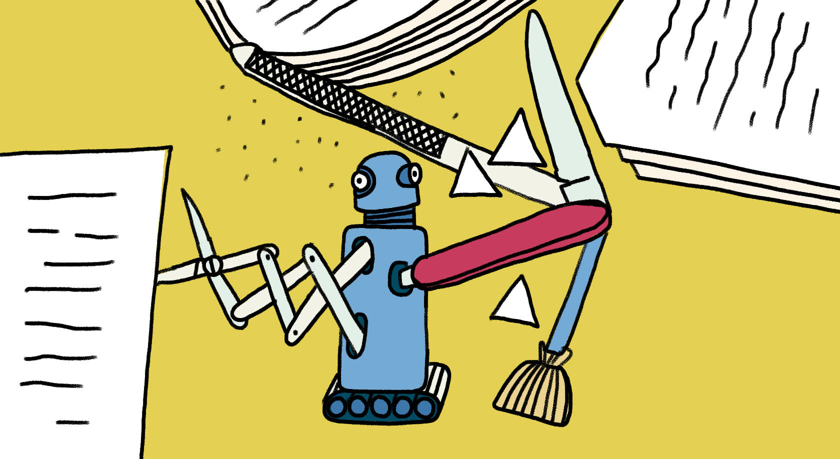

22 сентября 2025 года исполняется 125 лет со дня рождения самого обаятельного лексикографа XX века — Сергея Ивановича Ожегова (1900–1964). Он родился на переломе эпох — и такой же неспокойной была его филологическая жизнь. Некоторые вехи его биографии по просьбе Грамоты напоминает историк науки Олег Никитин.

...22 сентября 2025 года исполняется 125 лет со дня...

...Вначале революция и Гражданская война, которые прервали...